Harnessing the Power of LLMs in Practice: A Survey on ChatGPT and Beyond

为实践者和终端用户提供了一份全面且实用的指南,旨在帮助他们在下游自然语言处理(NLP)任务中使用大语言模型(LLM)。本文从模型、数据和下游任务的角度提供了关于LLM使用的讨论和见解,旨在为研究人员和实践者提供有价值的洞察和最佳实践,从而使这些模型在各种NLP任务中得到成功应用。

本文为实践者和终端用户提供了一份全面且实用的指南,旨在帮助他们在下游自然语言处理(NLP)任务中使用大语言模型(LLM)。本文从模型、数据和下游任务的角度提供了关于LLM使用的讨论和见解,旨在为研究人员和实践者提供有价值的洞察和最佳实践,从而使这些模型在各种NLP任务中得到成功应用。

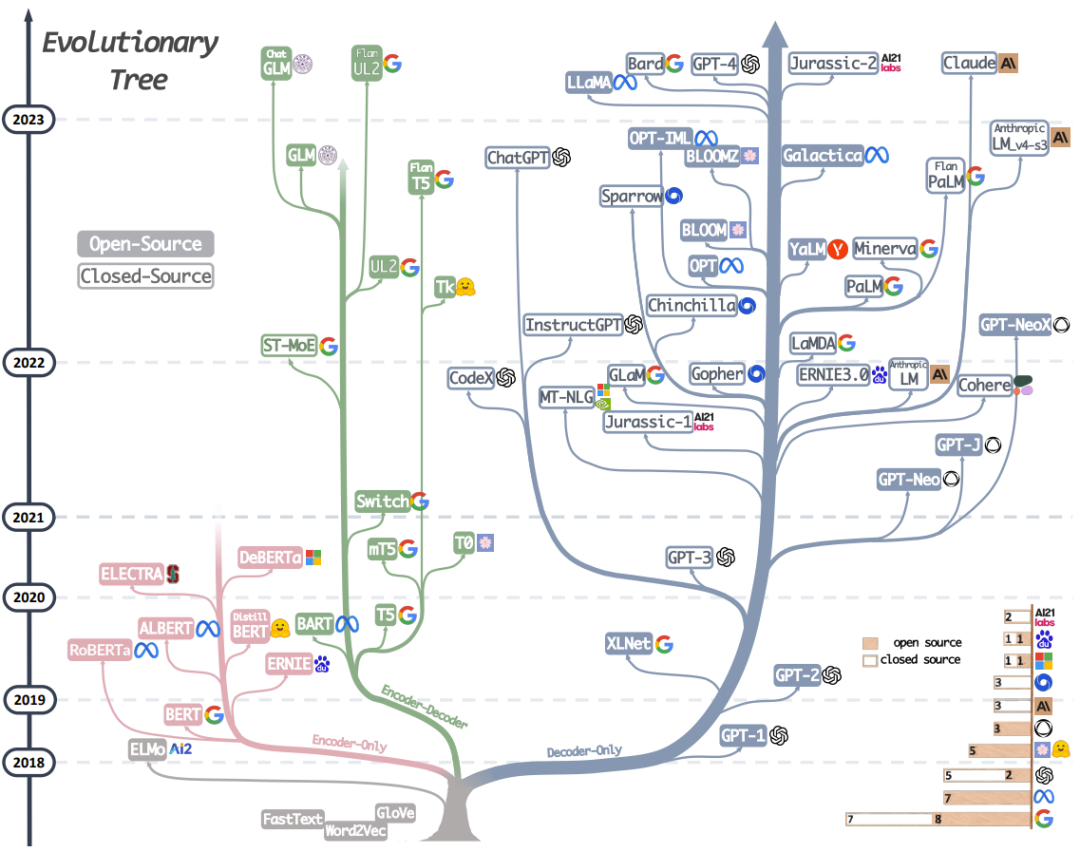

这幅现代 LLM 的进化树追溯了近些年语言模型的发展历程,其中重点凸显了某些最知名的模型。同一分支上的模型关系更近。基于 Transformer 的模型都不用灰色表示:仅解码器模型是蓝色分支,仅编码器模型是粉色分支,编码器 – 解码器模型是绿色分支。模型在时间轴的竖直位置表示其发布时间。实心方块表示开源模型,空心方块则是闭源模型。右下角的堆积条形图是指各家公司和机构的模型数量。

关键思路:

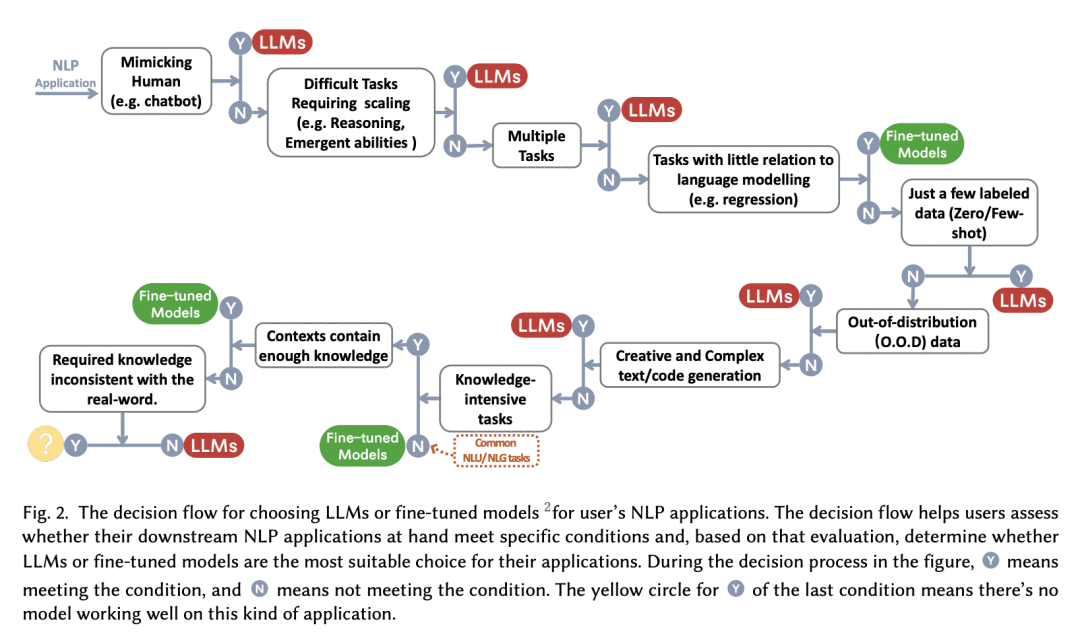

论文首先介绍了当前GPT和BERT风格的LLMs,然后从预训练数据、训练数据和测试数据的角度讨论了它们的影响。最重要的是,论文详细讨论了在各种自然语言处理任务中使用大型语言模型的使用情况和非使用情况,例如知识密集型任务、传统的自然语言理解任务、自然语言生成任务、新兴能力以及特定任务的考虑因素。论文通过各种使用情况和非使用情况来说明LLMs在现实场景中的实际应用和局限性。此外,论文还探讨了偏见对LLMs的影响以及其他重要考虑因素,例如效率、成本和延迟,以确保全面了解在实践中部署LLMs。相比当前这个领域的研究状况,该论文的思路在于提供一个实用性的指南,为使用LLMs的从业者提供实用的建议和指导。

其他亮点:

论文提供了使用LLMs的各种用例和非用例,以说明它们在现实世界场景中的实际应用和局限性。此外,论文还探讨了偏见对LLMs的影响以及其他重要考虑因素,例如效率、成本和延迟,以确保全面了解在实践中部署LLMs。

关于作者:

Jingfeng Yang, Hongye Jin, Ruixiang Tang, Xiaotian Han, Qizhang Feng, Haoming Jiang, Bing Yin, Xia Hu。

论文摘要:

本文为从事下游自然语言处理(NLP)任务的实践者和终端用户提供了一份全面实用的指南,以利用大型语言模型(LLMs)的能力。我们从模型、数据和下游任务的角度提供了LLMs的使用讨论和见解。首先,我们介绍和简要总结了当前GPT和BERT风格的LLMs。然后,我们讨论了预训练数据、训练数据和测试数据的影响。

最重要的是,我们详细讨论了LLMs在各种自然语言处理任务中的使用和非使用情况,例如知识密集型任务、传统自然语言理解任务、自然语言生成任务、新兴能力以及特定任务的考虑因素。我们提供了各种使用案例和非使用案例,以说明LLMs在实际场景中的实际应用和限制。我们还尝试了解数据的重要性以及每个NLP任务所面临的具体挑战。

此外,我们探讨了偏见对LLMs的影响以及其他重要考虑因素,例如效率、成本和延迟,以确保全面了解在实践中部署LLMs。这份全面的指南旨在为研究人员和从业人员提供有价值的见解和最佳实践,从而使这些模型能够成功地实现在各种NLP任务中的应用。

策划清单:

论文提供了一个包含LLMs实用指南资源的策划清单

https://github.com/Mooler0410/LLMsPracticalGuide