论文地址:https://arxiv.org/abs/2205.10803

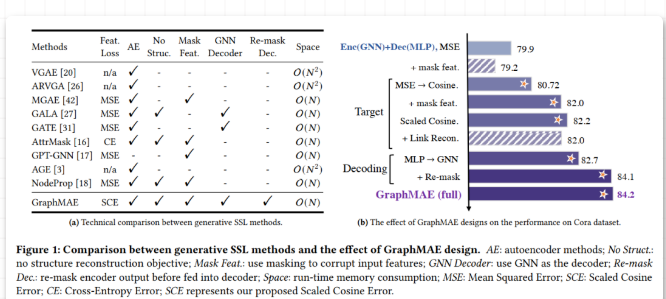

生成式自监督模型在NLP和CV领域得到广泛应用,而在graph领域对比学习占据主导地位,不论是节点分类还是图分类任务,生成式自监督的性能都被对比学习甩“几条街”。虽然如此,对比学习却有着致命缺陷,它要么过度依赖于数据增广,要么需要使用负采样、动量更新或指数滑动平均等策略来避免训练时陷入平凡解。而生成式自监督,特别是图自编码器通常目标是重建图自身的节点特征或结构信息,则会完全规避对比学习的局限。本文发现利用图自编码器,稍加改进,仅仅重建节点特征便能够获得优越的性能。GraphMAE的改进如下图所示:

概括地讲,改进主要是四点:1,掩码特征重建,不重建边;2,不同于大多数图自编码器使用的均方误差,GraphMAE使用缩放余弦误差作为损失函数;3,将编码器输出的嵌入重新掩码后再输入到解码器中;4,比起大多数图自编码器的解码器用多层感知机,GraphMAE的解码器使用图神经网络。

GraphMAE在无监督节点分类、无监督图分类以及在分子性质预测上的迁移学习三个任务共21个数据集上取得了与对比学习差不多,甚至是更好的效果。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...