Training Data Protection with Compositional Diffusion Models

Aditya Golatkar, Alessandro Achille, Ashwin Swaminathan, Stefano Soatto

[AWS AI Labs]

基于组合扩散模型的数据保护训练

-

动机:随着扩散模型在生成图像等方面的应用越来越广泛,如何保护大规模训练数据的问题变得越来越重要。这包括限制训练样本的影响、移除错误包含在训练中的样本的影响,以及防止模型记忆和生成与训练数据相似的样本等。 -

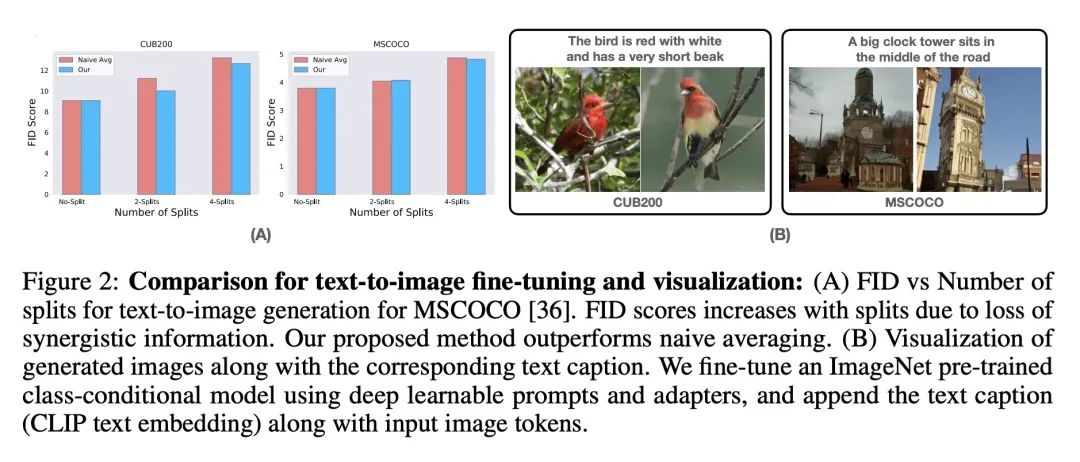

方法:提出Compartmentalized Diffusion Models(CDM),一种训练不同扩散模型(或提示)在不同数据源上,并在推理时任意组合它们的方法。每个模型只包含其在训练期间接触到的数据子集的信息,从而实现了多种形式的训练数据保护。 -

优势:CDM是首个能实现大规模扩散模型的选择性遗忘和持续学习的方法,同时还允许根据用户的访问权限提供定制的模型。此外,CDM还可以确定生成特定样本时数据子集的重要性。

提出一种新的扩散模型,即Compartmentalized Diffusion Models(CDM),可以在不同的数据源上独立训练,在推理时进行组合,从而实现了对训练数据的保护,其性能与同时在所有数据上训练的模型相当。

https://arxiv.org/abs/2308.01937

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...